2. 北京航空航天大学物理学院,北京 102206;

3. 清华大学工程物理系,北京 100084

2. School of Physics, Beihang University, Beijing 102206, China;

3. Department of Engineering Physics, Tsinghua University, Beijing 100084, China

随着调强放疗、立体定向放疗等技术的广泛应用,肿瘤靶区内外的剂量梯度更加陡峭[1]。传统图像引导放疗(image-guided radiation therapy,IGRT)已大幅减少了摆位误差,但解剖结构变化、CT图像电子密度误差等因素造成的剂量偏差,不仅对治疗效果产生不利影响,而且可能对正常器官造成损伤[2-4]。这些问题的解决需要在线自适应放疗(adaptive radiotherapy,ART)等先进技术的发展,而通过创新机载成像方法同时获得准确的解剖结构和物质分解信息[5-10]则是其中的关键技术瓶颈之一。

双能CT(dual energy CT,DECT)技术不仅可改进剂量计算精度,还可以提供更多重要数据,如精确量化组织中的碘浓度可用于评估肿瘤治疗效果[11]。但商用DECT用于加速器机载图像引导尚未成熟,且基于重复扫描的双能成像技术可能增加患者额外的辐射剂量、时间和经济成本等。本研究旨在结合DECT和稀疏重建技术,以低剂量获取解剖结构信息,利用深度学习合成高质量双能物质分解图像(MDI),为在线自适应放疗提供精准的低剂量智能成像方法。

材料与方法 1、数值仿真为了模拟不同的人体情况,本研究采用混合模体来构建身体中的各个器官,以提供真实的像素化模型。具体而言,通过改变XCAT数字模型工具中的体型、胸腹、心脏等13个解剖结构参数变量,分别生成形态各异的训练集患者50例、验证集患者10例、测试集患者各10例。其中男性和女性患者的比例为1∶1,共计70例仿真数字图像[12-13]。每个患者图像选取了75个轴向横截面,共计4 500层图像用于训练和验证,750层图像用于测试。设置的变量参数服从期望为1.0、方差为0.04的正态分布。对于50例训练集和10例验证集患者,分别基于管电压为80和125 kV的数据重建DECT图像(DECT1),代表患者放疗准备阶段的解剖结构资料。通过进一步调整生理形变参数来模拟放疗过程中同一患者解剖结构的前后变化,并基于形变后的数据模拟重建放疗引导中的CBCT图像。CBCT的管电压设置为80 kV,几何结构模拟使用了美国瓦里安OBI kV CBCT系统的参数设置,并从87个不同机架角度生成投影图像用于CBCT重建。相对于传统CBCT 360°扫描所需的约630个投影[14],本研究仅使用了87个投影。

本研究使用美国瓦里安OBI kV CBCT系统几何参数仿真投影图像。其中,扫描模式为半扇形,源到探测器距离为1 500 mm,源到旋转轴距离为1 000 mm,探测器偏移量为148 mm,探测器大小为397mm×298mm。重建图像大小为512×512×50,重建像素大小为0.75mm×0.75mm×2mm。旋转角度为360°。

为评估深度学习模型利用DECT1和CBCT合成物质分解图像的准确性,基于上述设置和5位测试集患者形变后的图像,重建与CBCT解剖结构一致的DECT(DECT2)并作为真值。每名患者重建后的DECT和CBCT分别包含150层图像。

2、物质分解基于前文中获得的相同解剖结构80和125 kV的CT图像,本研究采用了Niu等[15]提出的迭代分解方法获得DECT双能分解图像。作为准备步骤,图像域直接分解使用基材料的线性衰减矩阵逆运算,见式(1):

| $ \left[\begin{array}{l} I_{M 1} \\ I_{M 2} \end{array}\right]=\left[\begin{array}{ll} V_{M 1, H} & V_{M 2, H} \\ V_{M 1, L} & V_{M 2, L} \end{array}\right]\left[\begin{array}{l} L A C_H \\ L A C_L \end{array}\right] $ | (1) |

式中,IM1和IM2分别代表 2种基材料的成分占比;LACH和LACL分别代表在高能和低能扫描中获得的线性衰减系数;分解矩阵(VM1, H、VM1, L、VM2, H、VM2, L)在标定时通过分别采集包含2种基材料的均匀区域在2种扫描模式下的CT值建立。

将直接分解结果作为迭代分解的初始解,并以此为基础进行最佳线性无偏估计,然后使用分解后图像的估计方差矩阵的逆作为最小平方项的惩罚权重。通过引入正则化项以增强图像的平滑度,即计算相邻像素值差异的平方和来促使图像更加平滑。此外,为了保持分解后图像的边界清晰,首先检测图像的边缘,并在正则化过程中保留这些边缘信息。这种方法通过使用分解图像的噪声方差-协方差矩阵来降噪,避免了直接求逆可能导致的基材料噪声放大问题。通过将骨和软组织的电子密度作为基材料进行迭代分解,可以分别得到骨分解图(material decomposition image of bone, MDIB)和软组织分解图(material decomposition image of soft tissue, MDIST),提高图像质量的同时也能清晰地呈现骨和软组织结构。

3、基于深度学习合成双能物质分解图为了实现从CBCT到MDI的非配对数据样式转换,本研究采用基于断层图像的2D CycleGAN方法。由Zhu等[16]提出的CycleGAN模型包括两个生成器和两个判别器。其中生成器根据输入的图像试图实现图像之间的转化,而判别器则尝试区分生成的图像和真实图像,进而不断提升生成器的生成效果。

为更好地实现单通道图像到双通道图像的转化,本研究对CycleGAN网络结构进行了调整和优化,基于单通道图像获得了物质信息更丰富的双通道图像。具体的改进过程包括:在网络前向循环(forward cycle,FC)中通过生成器-MDI(generator-MDI,GMDI)实现通过CBCT合成MDI的双通道图像(synthesis two-channel material decomposition image,s2C-MDI);然后通过生成器-CBCT(generator-CBCT,GCBCT) 从s2C-MDI生成循环CBCT(cycle-CBCT,cCBCT)。在后向循环(backward cycle,BC)中,通过GCBCT从2C-MDI生成合成CBCT(synthesis CBCT,sCBCT),然后GMDI从sCBCT生成循环2C-MDI(cycle 2C-MDI, c2C-MDI)。两个判别器(discriminator-MDI,DMDI)和(discriminator-CBCT,DCBCT) 分别用于评估s2C-MDI和sCBCT与真实输入图像的差距。

训练过程采用了英伟达(3070)GPU,并使用Adam优化器进行训练,学习率为0.000 2,批量大小为5。训练在130个轮后停止,此时验证损失开始趋于平稳。为了评估训练效果,本研究采用了结构相似性指数(structural similarity index, SSIM)、均方根误差(root mean square error, RMSE)和峰值信噪比(peak signal-to-noise ratio, PSNR)3种定量指标来评估生成图像和真实图像之间的相似性,以此反映网络的性能[17-18]。

SSIM值越接近1表示两幅图像之间的一致性越好;RMSE较低表示图像误差较小;PSNR值越大表示图像质量和一致性越好[11]。

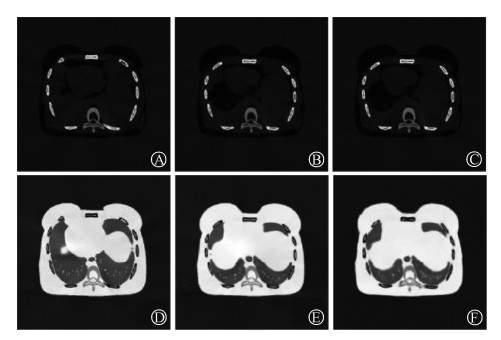

结果 1、测试集图像结果本研究基于XCAT共产生仿真患者数据70例,男性患者35例,女性患者35例。按照5∶1∶1划分为训练集、验证集和测试集。成功训练并验证了2D CycleGAN模型。利用5位男性和5位女性患者组成的测试集,基于他们放疗前的DECT和放疗当天发生解剖形变后的稀疏重建CBCT图像,模型成功合成了与放疗当天解剖结构一致的sMDIB和sMDIST。图 1为1例测试集女性结果,作为评估模型合成图像的参考真值,图 1B和图 1E分别展示了该测试集病例基于生理形变后125和80 kV双能CT迭代分解获得的MDIB和MDIST,其解剖结构与模型生成的图 1C和图 1F完全相同。而与图 1A和图 1D所代表的放疗计划阶段解剖结构则存在一定形变,模拟了患者放疗过程中的生理变化。

|

A. 基于治疗前DECT分解的MDIB图像;B. 治疗当日MDIB图像的真值参考;C. 模型基于治疗当日CBCT图像预测的合成sMDIB图像;D. 基于治疗前DECT分解的MDIST图像;E. 治疗当日MDIST图像的真值参考;F. 模型基于治疗当日CBCT图像预测的合成sMDIST图像 图 1 1例测试集结果 MDIB derived from the decomposition of pre-treatment DECT images; B. Ground truth image of MDIB on the treatment day; C. Synthesized sMDIB predicted based on CBCT images on the treatment day by the model; D. MDIST derived from the decomposition of pre-treatment DECT images; E. Ground truth image of MDIST on the treatment day; F. Synthesized sMDIST predicted based on CBCT images on the treatment day by the model Figure 1 Results of a test set A. |

2、测试集评估结果

表 1展示了测试集5例男性和5例女性375层合成图像与真值相比的SSIM、RMSE和PSNR的x±s,以及所有10例测试集患者共计750层图像结果的x±s。

|

|

表 1 测试集5例男性和5例女性375层合成图像与真值相比的SSIM、RMSE和PSNR的结果 Table 1 Results of SSIM, RMSE, and PSNR for the comparison between 375-slice synthesized images and ground truth images across for five males and five female cases in the test set |

3、训练及测试时长

基于前文所描述的硬件环境和参数设置,模型训练过程耗时约18 h 51 min。基于测试集患者的CBCT生成1层MDIB和MDIST图像分别耗时约0.65 s。

讨论作为当前临床使用最广泛的IGRT图像引导模态,CBCT除应用于传统的摆位误差修正外,也有望为剂量计算等更复杂的场景提供反映患者治疗当天真实解剖结构的图像信息,但其临床落地还面临成像剂量高、图像质量差和物质分解精度低等三方面亟待突破的技术瓶颈。针对这些问题,本研究提出了一种新的方法,即使用治疗前DECT所携带的物质分解信息,结合低剂量、少投影的CBCT所代表的治疗当日解剖结构,利用深度学习技术合成反映治疗当日真实情况的双能物质分解图。该方法具有患者辐射剂量低、不改变临床诊疗流程等优点。

本研究使用了数字仿真模体对该技术进行了可行性验证,基于改进的2D CycleGAN网络成功实现了从CBCT到MDI的图像模态转化。

数字模体可以基于计算机仿真技术生成虚拟患者的多模态影像数据。相比使用真实患者数据可能涉及的伦理风险和辐射安全等问题,或当面临无法通过实验获得患者数据时,数字仿真成为一种重要的替代性工具,因而在新技术可行性预研和临床试验阶段被广泛应用。数字仿真模体具有的独特优势还包括:非侵入性、可重复性、可精确控制实验条件、加快研究进程和生成基于已有知识的“真值”等。比如,数字模体的解剖学和生理学数据都是已知的,可以为评估和改进成像设备和技术的相关研究提供“金标准”[19]。在本研究中,数字仿真模体很好地解决了测试集真值构建的技术挑战,通过生成与CBCT解剖结构完全一致的双能CT,从而为模型合成图像的定量评估提供了标准,有效克服了不同扫描设备和人体非刚性结构等真实世界研究中普遍存在的“真值”缺失问题。

在进行网络训练时,使用了CBCT和MDIB、MDIST作为输入,输出为治疗当日患者的sMDIB和sMDIST。作为对2D CycleGAN模型的改进之一,本研究将MDIB和MDIST作为双通道图像输入和输出,在保证精度的前提下有效提高了训练效率,合成750层MDI图像仅需98 s,基本满足临床要求。未来还可以通过硬件升级和参数优化等方法进一步缩短耗时。同时,CycleGAN适用于弱监督甚至无监督的问题,可以有效应对真实临床场景中训练数据集缺乏配对的问题。由于CycleGAN可基于非配对训练数据实现两个域之间的图像转换,在医学图像领域得到了很多应用和改进。Liang等[20]2019年使用2D CycleGAN实现了CBCT图像到CT图像的转化,并与传统的循环生成网络进行了比较。Liang等[21]于2022年在传统的CycleGAN结构中添加了一个独立的预训练标准,以对图像翻译施加自适应控制。该模块的引入有效提高了网络的训练效果。Szmul等[22]于2023年在CycleGAN结构中引入了全局残差,并修改了CycleGAN损失函数,有效促进了源图像和合成图像之间的结构一致性。Ozbey等[23]于2023将CycleAN与diffusion模型结合,进一步提高了CycleGAN的性能,仅使用15例病人骨盆数据(其中训练集9例,验证集2例,测试集4例)便实现了磁共振(magnetic resonance, MR)到CT模态的转化。

测试集数据的构建过程充分考虑到了患者的多样性,包括性别、体型、器官大小等差异。本研究在减少86.2%的投影数量并大幅降低成像剂量的情况下,模型基于稀疏重建CBCT输出的测试集患者的sMDIB和sMDIST依然保持了与真实值的高度一致性,平均SSIM值≥0.983,平均RMSE值≤0.019,平均PSNR值≥34.409。本研究中提供的对比图像也印证了本研究的结果。以上数据表明,模型在保留CBCT所代表的正确解剖信息的同时,可以从存在生理形变的DECT中成功学习到精确的物质分解数据。既往研究表明,单能CT的HU和相对电子密度之间的对应关系并不稳定,特殊情况下的不确定性可高达7%[24],形变配准等后处理还可能进一步增加误差。相比之下,本工作将不确定度控制在了2%以内,且生成一层图像的时间仅需0.65 s,具有精度和效率的双重优势。

本研究还观察到,MDIB预测图像的PSNR和RMSE优于MDIST,但SSIM结果相反。可能的原因是:MDIB包含的图像细节相对较少,但图像结构和对比度上稍差于MDIST。在未来的研究工作中,可以进一步尝试通过增加网络通道数将MDIB和MDIST分开训练,但此举会增加训练时间且对硬件环境有更高的要求。此外,本研究虽然实现了图像转换,但是预测结果在图像对比度方面还存在一定的损失。为了进一步提高模型的预测能力,在后续研究中还将继续探索以下优化方案:①调整CycleGAN使用的损失函数,如调整原有损失函数的对比度或图像边界的权重,或者引入其他的损失函数如感知损失(perceptual loss)或内容损失(content loss),以提高图像的质量和对比度。②调整CycleGAN的模型架构,例如增加或减少层数、增加或减少过渡层、调整卷积核大小等,以提高模型的性能和图像的质量。③尝试对输入图像进行预处理,对输出图像进行后处理,例如调整亮度、对比度、色彩平衡等以提高图像的质量和对比度。以上优化方案的实施有望进一步提高CycleGAN的预测能力,为潜在的临床应用提供更高质量的图像。在商用机载DECBCT问世前,本研究有望为在线自适应放疗、在线质子/重离子计划设计、三维剂量重建和出射束监控等复杂临床应用场景提供低剂量、高精度的新型智能成像方法和数据。

此外,本研究的局限还在于:作为可行性验证的初步探索,虽然在仿真过程中采取了增加数据多样性等方案,但还是可能与真实患者情况存在偏差,且不同厂家和型号的CBCT也存在硬件构造和扫描参数等差异。这些变化对模型表现的影响,未来需要更多基于真实临床数据的深入研究。

利益冲突 无

作者贡献声明 董正坤负责网络训练和论文撰写;屈瑞、卢闫晔参与代码编写;余疏桐、华凌参与数据仿真;漆俊锋、牛田野负责双能分解算法指导;江萍负责数据形变仿真真实性评估;张艺宝负责实验设计和论文修改

| [1] |

Sterzing F, Engenhart-Cabillic R, Flentje M, et al. Image-guided radiotherapy: a new dimension in radiation oncology[J]. Dtsch Arztebl Int, 2011, 108(16): 274-280. DOI:10.3238/arztebl.2011.0274 |

| [2] |

Miralbell R, Bleher A, Huguenin P, et al. Pediatric medulloblastoma: radiation treatment technique and patterns of failure[J]. Int J Radiat Oncol Biol Phys, 1997, 37(3): 523-529. DOI:10.1016/s0360-3016(96)00569-x |

| [3] |

Dawson LA, Sharpe MB. Image-guided radiotherapy: rationale, benefits, and limitations[J]. Lancet Oncol, 2006, 7(10): 848-858. DOI:10.1016/S1470-2045(06)70904-4 |

| [4] |

Castadot P, Geets X, Lee JA, et al. Assessment by a deformable registration method of the volumetric and positional changes of target volumes and organs at risk in pharyngo-laryngeal tumors treated with concomitant chemo-radiation[J]. Radiother Oncol, 2010, 95(2): 209-217. DOI:10.1016/j.radonc.2010.03.007 |

| [5] |

Avgousti R, Antypas C, Armpilia C, et al. Adaptive radiation therapy: When, how and what are the benefits that literature provides?[J]. Cancer Radiother, 2022, 26(4): 622-636. DOI:10.1016/j.canrad.2021.08.023 |

| [6] |

Castadot P, Lee JA, Geets X, et al. Adaptive radiotherapy of head and neck cancer[J]. Semin Radiat Oncol, 2010, 20(2): 84-93. DOI:10.1016/j.semradonc.2009.11.002 |

| [7] |

Glide-Hurst CK, Lee P, Yock AD, et al. Adaptive radiation therapy (ART) strategies and technical considerations: a state of the ART review from NRG oncology[J]. Int J Radiat Oncol Biol Phys, 2021, 109(4): 1054-1075. DOI:10.1016/j.ijrobp.2020.10.021 |

| [8] |

Bertholet J, Anastasi G, Noble D, et al. Patterns of practice for adaptive and real-time radiation therapy (POP-ART RT) part Ⅱ: Offline and online plan adaption for interfractional changes[J]. Radiother Oncol, 2020, 153: 88-96. DOI:10.1016/j.radonc.2020.06.017 |

| [9] |

Qin A, Sun Y, Liang J, et al. Evaluation of online/offline image guidance/adaptation approaches for prostate cancer radiation therapy[J]. Int J Radiat Oncol Biol Phys, 2015, 91(5): 1026-1033. DOI:10.1016/j.ijrobp.2014.12.043 |

| [10] |

de Jong R, Crama KF, Visser J, et al. Online adaptive radiotherapy compared to plan selection for rectal cancer: quantifying the benefit[J]. Radiat Oncol, 2020, 15(1): 162. DOI:10.1186/s13014-020-01597-1 |

| [11] |

Kassaee A, Cheng C, Yin L, et al. Dual-energy computed tomography proton-dose calculation with scripting and modified hounsfield units[J]. Int J Part Ther, 2021, 8(1): 62-72. DOI:10.14338/IJPT-20-00075.1 |

| [12] |

Segars WP, Sturgeon G, Mendonca S, et al. 4D XCAT phantom for multimodality imaging research[J]. Med Phys, 2010, 37(9): 4902-4915. DOI:10.1118/1.3480985 |

| [13] |

Segars WP, Tsui B, Cai J, et al. Application of the 4-D XCAT phantoms in biomedical imaging and beyond[J]. IEEE Trans Med Imaging, 2018, 37(3): 680-692. DOI:10.1109/TMI.2017.2738448 |

| [14] |

Brink C, Lorenzen EL, Krogh SL, et al. DBCG hypo trial validation of radiotherapy parameters from a national data bank versus manual reporting[J]. Acta Oncol, 2018, 57(1): 107-112. DOI:10.1080/0284186X.2017.1406140 |

| [15] |

Niu T, Dong X, Petrongolo M, et al. Iterative image-domain decomposition for dual-energy CT[J]. Med Phys, 2014, 41(4): 041901. DOI:10.1118/1.4866386 |

| [16] |

Zhu JY, Park T, Isola P, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks[C]. IEEE International Conference Comput Vision (ICCV), 2017: 2242-2251. DOI: 10.1109/ICCV.2017.244.

|

| [17] |

Chai T, Draxler RR. Root mean square error (RMSE) or mean absolute error (MAE)? - Arguments against avoiding RMSE in the literature[J]. Geosci Model Dev, 2014, 7: 1247-1250. DOI:10.5194/gmd-7-1247-2014 |

| [18] |

Zhou L, Schaefferkoetter JD, Tham I, et al. Supervised learning with cyclegan for low-dose FDG PET image denoising[J]. Med Image Anal, 2020, 65: 101770. DOI:10.1016/j.media.2020.101770 |

| [19] |

Wang Z, Bovik AC, Sheikh HR, et al. Image quality assessment: from error visibility to structural similarity[J]. IEEE Trans Image Process, 2004, 13(4): 600-612. DOI:10.1109/tip.2003.819861 |

| [20] |

Liang X, Chen L, Nguyen D, et al. Generating synthesized computed tomography (CT) from cone-beam computed tomography (CBCT) using CycleGAN for adaptive radiation therapy[J]. Phys Med Biol, 2019, 64(12): 125002. DOI:10.1088/1361-6560/ab22f9 |

| [21] |

Liang Z, Huang JX, Antani S. Image translation by ad cycleGAN for COVID-19 X-ray images: a new approach for controllable GAN[J]. Sensors (Basel), 2022, 22(24): 9628. DOI:10.3390/s22249628 |

| [22] |

Szmul A, Taylor S, Lim P, et al. Deep learning based synthetic CT from cone beam CT generation for abdominal paediatric radiotherapy[J]. Phys Med Biol, 2023, 68(10): 105006. DOI:10.1088/1361-6560/acc921 |

| [23] |

Ozbey M, Dalmaz O, Dar S, et al. Unsupervised medical image translation with adversarial diffusion models[J]. IEEE Trans Med Imaging, 2023, 42(12): 3524-3539. DOI:10.1109/TMI.2023.3290149 |

| [24] |

Sudhyadhom A. On the molecular relationship between Hounsfield Unit (HU), mass density, and electron density in computed tomography (CT)[J]. PLoS One, 2020, 15(12): e0244861. DOI:10.1371/journal.pone.0244861 |

2024, Vol. 44

2024, Vol. 44