2. 天津医科大学肿瘤医院放射治疗科, 天津 300060;

3. 天津市第一中心医院放射治疗科, 天津 300190;

4. 中国医学科学院放射医学研究所辐射检测与评价中心, 天津 300192

2. Department of Radiation Oncology, Tianjin Medical University Cancer Institute and Hospital, Tianjin 300060, China;

3. Department of Radiation Oncology, Tianjin First Central Hospital, Tianjin 300192, China;

4. Institute of Radiation Medicine, Chinese Academy of Medical Sciences, Tianjin 300192, China

锥形束计算机体层成像(cone bean computed tomography,CBCT)是放射治疗中校正治疗摆位误差的标准影像信息,然而图像存在分辨率低和CT值准确性低的不足,并不能为放射治疗中靶区勾画和计划设计等流程提供高质量图像,限制其在自适应治疗中的进一步应用。

双能成像技术通过使用两种不同的能谱扫描患者,充分利用线性衰减系数的能量依赖性,提供虚拟单能成像和特征图像,提高组织分辨能力,在金属伪影减少、光束硬化校正、对比度和噪声优化以及材料鉴别中广泛应用[1-2]。研究表明,双能成像技术具有提高近距离放疗和质子治疗剂量计算精度的作用,应用于金属伪影减少技术和正常组织表征方面的临床放疗[3]。在放射治疗中发展双能CBCT成像技术,特别是在自适应放射治疗中,增强图像组织可视力[4],可基于图像对靶区在线勾画和实时计划更新,为病患提供个体化精准治疗方案,提高自适应治疗的局部控制率[5]。

双能成像技术实施依赖高性能的X射线源和探测器以保证双能射束在时间和空间的一致性匹配[4],该技术对CBCT扫描设备硬件结构要求较高,而且目前临床实践中并未有商用的双能CBCT设备,因此在获取高低能量图像时多次扫描会引入额外的辐射风险[6]。近年来深度学习在医学图像处理和分析领域发展迅速,而基于深度学习的单双能成像转换技术研究均以CT图像为基础[7-11],研究表明,使用低能CT图像生成高能CT图像是可行的,在不适用双能CT扫描的情况下仍可以获取双能图像。本研究基于深度学习的方法,将低能量CBCT图像转换成高能量CBCT图像,为临床双能CBCT成像技术提供图像基础,解决双能技术图像获取不倚重硬件设备的问题,改善低能CBCT图像质量,同时降低病患的辐射风险,进而提高CBCT图像在放射治疗中的应用。

材料与方法1. 数据来源:高低能量CBCT图像均采集自天津医科大学肿瘤医院放射治疗科Halcyon加速器机载锥形束CT扫描设备(美国Varian公司),采用CIRS电子密度模(CIRS 062 M,模体1)和CIRS头模(CIRS 136500,模体2)两种体模。扫描协议是每种体模分别在80 kV/270 mAs,140 kV/270 mAs能量下进行照射,获取高能和低能下各93张DICOM图像。CBCT图像分辨率大小为0.511 mm × 0.511 mm,其尺寸在轴向平面上是512 × 512,层厚为1.99 mm。参与U-Net网络模型训练的数据集和测试的数据集比重为10∶1。数据分类原则遵循随机性,将数据集多次随机划分并对多次划分结果取平均值,确保测试数据集包含两种模体图像。

2. 图像预处理:采用半径200像素的圆形掩膜去除部分环状伪影干扰,所有训练和测试数据集由DICOM图像转为灰度图像,并对训练集进行数据增强,包括旋转、缩放、裁剪与翻转等操作,以防止模型过拟合。

3. 网络设置:采用标准U-Net网络[12]作为具体架构,输入图片为80 kV CBCT图像,输出图片为140 kV CBCT图像。网络结构由卷积编码(下采样)和卷积解码(上采样)2条对称路径组成,下采样和上采样均采样4次,并在同一层使用拼接操作。下采样路径中编码路径部分每一层都使用2次3 × 3的卷积核对图像进行卷积。每层卷积特征图填充设置值为1。池化层采用平均池化层。上采样路径采用卷积核为2 × 2的二维转置卷积,步长为2。均采用LeakyReLu非线性激活函数。

4. 实验环境:采用python=3.8,pytorch=2.0.1版本,在NVIDIA GeForce RTX 3080 GPU上运行程序。在输入网络训练前,将图片转成Tensor格式,形式为(channel,height,width)。在网络训练中迭代次数设置为1 000次,批次大小为1,均方误差(MSE)作为损失函数,采用Adam优化算法调整网络参数,学习率为10-5。

5. 评价指标:为了量化真实和预测的DECT图像之间的视觉相似性,采用平均绝对误差(mean absolute error,MAE)、结构相似度指数(structure similarity index,SSIM)、信噪比(signal-to-noise ratio,SNR)和峰值信噪比(peak signal-to-noise ratio,PSNR)4种度量指标,定量评价预测高能CBCT图像与真实高能CBCT的差异。

6. 数据分析:为了定量比较真实和预测的140 kV图像的CT值差异,将所有测试数据结果灰度图像映射至真实140 kV图像的数值范围进行比例调整,并利用DICOM图像头文件中的斜度(rescale slope)和截距(rescale intercept)恢复图像CT值。设置4个半径为40像素、圆心像素坐标分别为(256,256)(150,150)(175,350)(325,325)的圆形感兴趣区域(ROI),计算感兴趣区域(ROI)CT值的均值和标准差,定量分析真实高能CBCT和预测高能CBCT图像差异。

7. 统计学处理:采用SPSS26.0进行分析。符合正态分布的结果以x±s表示,对预测结果与真实结果进行配对样本t检验。P < 0.05为差异有统计学意义。

结果使用U-Net网络可从低能80 kV CBCT图像预测生成高能140 kV CBCT图像,且从评价参数可知与真实高能140 kV CBCT图像较高相似度。训练阶段迭代次数1 000次,网络训练时间是1.14 h,测试阶段完成1幅低能CBCT图像转换到高能CBCT图像的时间平均2.03 s。

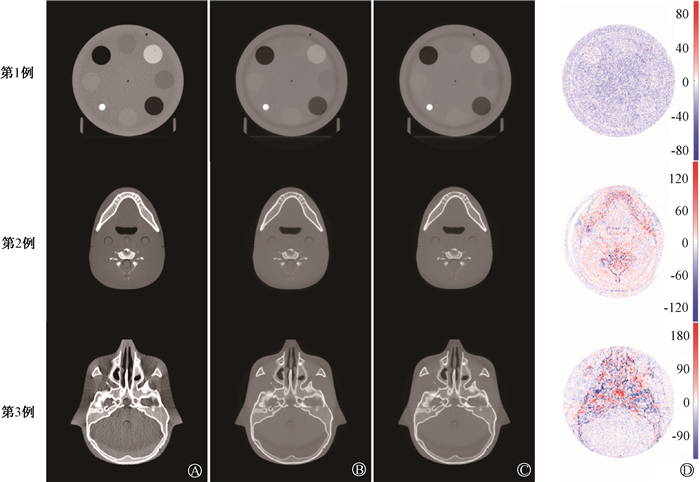

图 1所示3例测试集数据中原始80 kV CBCT图像、真实和预测140 kV CBCT图像及两者之间的差值图像,可以观测预测高能CBCT图像较与真实高能CBCT图像相似,差异较小。预测高能CBCT图像与真实高能CBCT图像之间的平均SSIM指数是0.993 ± 0.003,显示两者图像总体结构差异较小。预测高能图像比真实高能图像SNR值高(15.33±4.06),具有较低噪声。

|

A. 初始低能80 kV CBCT图像;B. 真实高能140 kV CBCT图像;C. 预测高能140 kV CBCT图像;D. CT值差值图像 图 1 基于U-Net网络预测高能图像与真实图像的比较 A. Initial low-energy 80 kV CBCT image; B. Real high-energy 140 kV CBCT images; C. Predicted high-energy 140 kV CBCT images; D. CT value difference images Figure 1 Comparison of the predicted high-energy images based on U-Net network and real images |

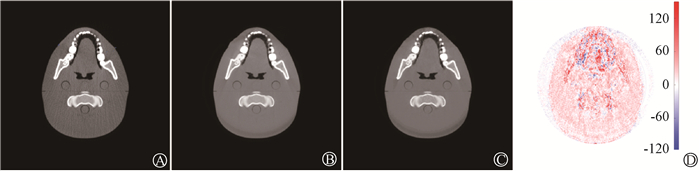

将真实高能图像作为参考,获取的预测高能图像与初始低能CBCT图像比较,具有较低平均MAE(7.33±3.53)和(84.87±30.52)HU,平均PSNR显著提升[(43.90±4.31)和(28.70±0.71)dB]。如图 2所示,基于U-Net网络生成的高能图像因高密度组织或金属所带来的伪影显著减少。

|

A. 初始低能80 kV CBCT图像;B. 真实高能140 kV CBCT图像;C. 预测高能140 kV CBCT图像;D. CT值差值图像 图 2 低能金属伪影图像与预测高能图像的比较 A. Initial low-energy 80 kV CBCT image; B. Real high-energy 140 kV CBCT images; C. Predicted high-energy 140 kV CBCT images; D. CT value difference images Figure 2 Comparison of low-energy images with metal artifact and predicted high-energy images |

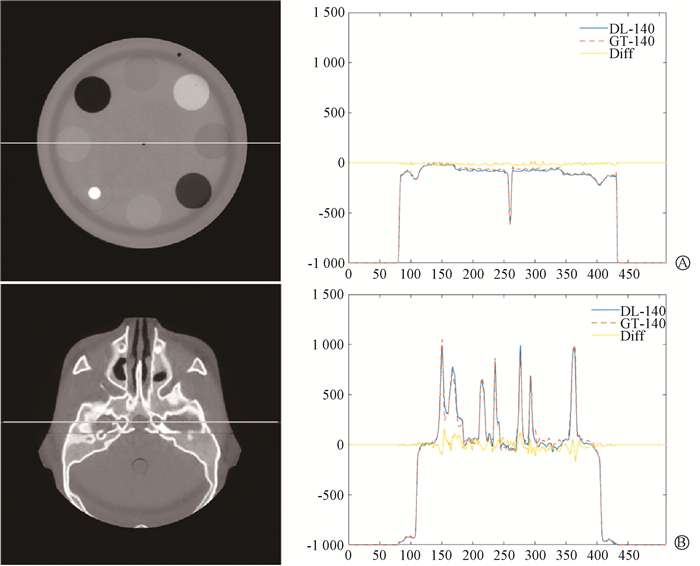

图 3显示预测140 kV CBCT图像和真实140 kV CBCT图像在冠状轴上的CT值分布及差异,可以看出预测高能图像在不同组织中分辨力与真实高能图像相近,CT值差异较小。为了量化CT值差异,在测试数据集中勾画4个感兴趣区域,统计计算平均HU差异如表 1所示。预测140 kV图像比真实140 kV图像平均CT值略高,CT值在两组图像上差异有统计学意义(t = -2.95,P = 0.01),且CT值差值在-13.47 ~ -8.66 HU之间。

|

A. CIRS 062M模体;B. CIRS 136500模体 图 3 预测140 kV图像(DL-140)和真实140 kV图像(GT-140)冠状轴上CT值及差异(Diff)分布图 A. CIRS 062M phantom; B. CIRS 136500 phantom Figure 3 The distribution of CT values and differences(Diff) on the coronal section of predicted 140 kV images (DL-140) and real 140 kV images (GT-140) |

|

|

表 1 预测140 kV图像和真实140 kV图像在4个ROI区域CT值和SNR值 Table 1 CT values and SNR of predicted 140 kV images and real 140 kV images in 4 ROI regions |

针对模体1中,不同类型组织的平均CT值及预测高能图像和真实高能图像CT值差异如表 2所示。预测高能图像平均CT值低于真实高能图像平均CT值,在低密度组织中,如肺、脂肪、胸、肌肉和肝,平均CT值差值< 10 HU,两者之间的平均CT值差异没有统计学意义(P=0.22),而在高密度组织中,如骨小梁和骨密质,CT值差异可至20 HU,两者之间的平均CT值差异有统计学意义(t = -7.92,P = 0.02)。

|

|

表 2 预测和真实140 kV图像在CRIS 062M模体不同组织中CT值 Table 2 CT values of predicted 140 kV images and real 140 kV images in different tissues of CRIS 062M phantom |

讨论

本研究提出一种基于U-Net网络的深度学习的方法,可以实现由低能CBCT图像(80 kV)生成高能CBCT图像(140 kV)。在训练过程中,随着迭代次数的增加,初始高能CBCT图像与基于U-Net网络深度学习生成的预测高能CBCT图像之间的MAE逐渐减少,PSNR、SSIM逐渐增大,图像相似度越来越高。通过测试结果表明,采用临床现有低能CBCT扫描协议下的图像可以转化成高能CBCT图像,由测试集图像的评价参数可以表明预测图像与真实高能CT图像具有较高的一致性(SSIM:0.993±0.003),有效改善CBCT图像质量(SNR:15.33±4.06),降低低能CBCT图像伪影,仅利用单次低能扫描图像为双能CBCT成像技术提供图像基础,降低病患的辐射风险。

现有研究表明,利用深度学习方法可以从低能CT图像生成高能CT图像,由于目前尚未有临床商用双能CBCT设备,且放疗临床尚未开展双能成像实例,本研究在放疗临床机载CBCT分两次采集高低能量下两种体模的图像数据,确保图像获取的空间和时间一致性。SSIM参数结果显示,利用U-Net网络的方法所获得的结果与CT图像研究结果一致(0.997)[7],而优于利用基于对抗生成网络方法(0.645)[8]。PSNR参数在髋关节CT研究(27.22 dB)[8]和头颈部鳞状细胞癌患者CT研究(29.28 dB)[9]低于本研究结果(43.9 dB),由评价参数比较可知,U-Net网络在低能图像向高能图像转换方法中具有一定优势。

经过U-Net网络训练后的预测高能CBCT图像,CIRS电子密度模体比CIRS头模的转化效果较好,MAE参数较低[(5.447±3.036)和(9.511±3.571)]。而在CIRS头模预测高能图像中,与原始高能图像比较差异主要存在软组织和骨之间的差异变化较平滑。与CT高低能图像转化相关研究相比[10-11],不同组织感兴趣区域的CT值差异优势不大,基于深度学习生成的CBCT高能图像CT值偏低。尽管80~140 kV的双能成像比100~140 kV的双能成像具有更大的光谱分离,利于双能成像的图像对比度[12],但80 kV能量下的CBCT图像因射束散射较大而图像噪声较高,且在组织分辨力低,因此对深度学习网络的模型的建立造成一定影响,后续可以继续针对模型输入的低能CBCT图像降噪问题做进一步研究[13-14]。

本研究的局限性主要在于,CBCT图像样本来源于体模数据,且样本量较少,后续可以进行动物实验来获取更多图像样本。低能量(80 kV)CBCT图像本身噪声较大,对模型的训练和测试的影响有待进一步研究。同时,可采用不同深度学习网络模型来验证高低能CBCT图像转换方法的通用性。

综上,本研究基于深度学习的方法,训练一种将低能(80 kV)CBCT图像转换成高能(140 kV)CBCT图像的U-Net网络,生成的预测高能CBCT图像与真实高能CBCT图像结构相似度高。该方法能有效改善CBCT图像质量,且降低病患的辐射风险,进而提高双能CBCT图像在放射治疗中的应用价值。

利益冲突 无

作者贡献声明 明鑫负责方案设计和论文撰写;杨成文负责采集数据和实施研究;孟慧鹏、翟贺争负责分析数据和审阅数据;程钰翔负责起草论文和文献整理;杨淼龙负责处理数据。

| [1] |

McCollough CH, Boedeker K, Cody D, et al. Principles and applications of multienergy CT: Report of AAPM Task Group 291[J]. Med Phys, 2020, 47(7): e881-e912. DOI:10.1002/mp.14157 |

| [2] |

Pomerantz SR, Kamalian S, Zhang D, et al. Virtual monochromatic reconstruction of dual-energy unenhanced head CT at 65-75 keV maximizes image quality compared with conventional polychromatic CT[J]. Radiology, 2013, 266(1): 318-325. DOI:10.1148/radiol.12111604 |

| [3] |

van Elmpt W, Landry G, Das M, et al. Dual energy CT in radiotherapy: current applications and future outlook[J]. Radiother Oncol, 2016, 119(1): 137-144. DOI:10.1016/j.radonc.2016.02.026 |

| [4] |

Forghani R, Mukherji SK. Advanced dual-energy CT applications for the evaluation of the soft tissues of the neck[J]. Clin Radiol, 2018, 73(1): 70-80. DOI:10.1016/j.crad.2017.04.002 |

| [5] |

Sajja S, Lee Y, Eriksson M, et al. Technical principles of dual-energy cone beam computed tomography and clinical applications for radiation therapy[J]. Adv Radiat Oncol, 2020, 5(1): 1-16. DOI:10.1016/j.adro.2019.07.013 |

| [6] |

李晨光, 牛田野, 周莉, 等. 双能锥形束CT的分解算法和成像物体尺寸依赖性研究[J]. 中华放射医学与防护杂志, 2022, 42(4): 269-276. Li CG, Niu TY, Zhou L, et al. Two decomposition algorithms of dual-energy cone beam CT and their dependence on the phantom sizes[J]. Chin J Radiol Med Prot, 2022, 42(4): 269-276. DOI:10.3760/cma.j.cn112271-20211206-00471 |

| [7] |

Liu CK, Liu CC, Yang CH, et al. Generation of brain dual-energy CT from single-energy CT using deep learning[J]. J Digit Imaging, 2021, 34(1): 149-161. DOI:10.1007/s10278-020-00414-1 |

| [8] |

Zhou H, Liu X, Wang H, et al. The synthesis of high-energy CT images from low-energy CT images using an improved cycle generative adversarial network[J]. Quant Imaging Med Surg, 2022, 12(1): 28-42. DOI:10.21037/qims-21-182 |

| [9] |

Charyyev S, Wang T, Lei Y, et al. Learning-based synthetic dual energy CT imaging from single energy CT for stopping power ratio calculation in proton radiation therapy[J]. Br J Radiol, 2022, 95(1129): 20210644. DOI:10.1259/bjr.20210644 |

| [10] |

Lyu T, Zhao W, Zhu Y, et al. Estimating dual-energy CT imaging from single-energy CT data with material decomposition convolutional neural network[J]. Med Image Anal, 2021, 70: 102001. DOI:10.1016/j.media.2021.102001 |

| [11] |

Zhao W, Lv TL, Gao P, et al. Dual-energy CT imaging using a single-energy CT data is feasible via deep learning[J]. arXiv preprint arXiv: 190604874 2019. DOI: 10.48550/arXiv.1906.04874.

|

| [12] |

Primak AN, Giraldo JC, Eusemann CD, et al. Dual-source dual-energy CT with additional tin filtration: Dose and image quality evaluation in phantoms and in vivo[J]. AJR Am J Roentgenol, 2010, 195(5): 1164-1174. DOI:10.2214/AJR.09.3956 |

| [13] |

Rusanov B, Ebert MA, Mukwada G, et al. A convolutional neural network for estimating cone-beam CT intensity deviations from virtual CT projections[J]. Phys Med Biol, 2021, 66(21): 215007. DOI:10.1088/1361-6560/ac27b6 |

| [14] |

张文君, 黄钢, 丁海宁, 等. 基于深度学习的医用锥形束CT图像散射伪影校正的研究进展[J]. CT理论与应用研究, 2022, 32: 1-12. Zhang WJ, Huang G, Ding HN, et al. Research progress of scattering artifact correction in medical cone-beam computed tomography imaging based on deep learning[J]. CT Theo Appl, 2022, 32: 1-12. DOI:10.15953/j.ctta.2022.131 |

2023, Vol. 43

2023, Vol. 43