乳腺癌是女性最常见的恶性肿瘤之一, 目前已超越肺癌成为全球癌症发病率最高的癌种[1-2]。中国作为乳腺癌高发国家,近年发病率持续增加[3]。乳腺癌术后辅助放射治疗能有效降低局部复发、改善患者生存、降低死亡风险,是乳腺癌综合治疗中的重要手段。准确地勾画乳腺癌临床靶区(clinical target volume,CTV)及危及器官(organs at risk,OAR),是放射治疗实施的基础和关键。然而,手动勾画效率低下,且不同医生之间的勾画缺乏标准化及一致性。近年来,国内外关于乳腺癌放疗靶区和危及器官的智能勾画研究越来越多,智能勾画能提高靶区的准确性和一致性,从而提升乳腺癌放疗效率[4-6]。U-Net是一种应用广泛的全卷积网络(fully convolutional network, FCN),其主要原理是基于解剖结构通过CT图像的变形矩阵勾画靶区及OAR,且该方法比常规的基于Patch分类法的图像分割方法效率更高[7]。本研究模型为3D版本的Unet,通过对乳腺癌术后辅助放疗智能靶区勾画结果的分析,探讨运用3D ResSE-Unet的智能勾画模型在乳腺癌辅助放疗靶区勾画中的应用前景。

资料与方法1. 病例资料: 回顾性选取2018年9月至2022年5月在广西医科大学附属第四附属医院肿瘤诊疗中心治疗进行乳腺癌术后辅助放疗病例的CT影像资料。入组乳腺癌保乳术或全乳切除术后患者,需行全乳腺或者胸壁联合或不联合锁骨上下引流区放疗; 排除需做腋窝、内乳照射,或有转移淋巴结残存需加量照射的患者。治疗前所有患者均签署了放射知情同意书。本研究获得广西医科大学第四附属医院伦理委员会的批准。

2. 体位固定及CT扫描: 纳入病例均采用仰卧位乳腺托架固定体位,在德国西门子公司的CT模拟定位机(SOMATOM Definition AS)完成放疗定位,且每个病例均为增强扫描,层厚5 mm,扫描范围为颈部环状软骨至乳腺下界5 cm,包括全部肺组织[8]。将扫描采集的CT图像通过DICOM传输至RayStation计划系统。

3. 靶区及OAR勾画: 所有病例的临床靶区勾画均由两位经验丰富的专科医生根据美国肿瘤放射治疗协作组织(RTOG)乳腺癌靶区勾画标准[9]及《肿瘤放射治疗学(乳腺癌术后放疗技术)》[10]勾画靶区:全乳切除术后的胸壁临床靶区(CTVcw),锁骨上下区靶区(CTV2);保乳术后全乳腺临床靶区(CTVb),部分患者需照射CTV2,然后两位高年资主治医生交叉修改对方的手动勾画,最后由主任医师完成手动勾画的评估,并在提出改进意见后进一步修改。

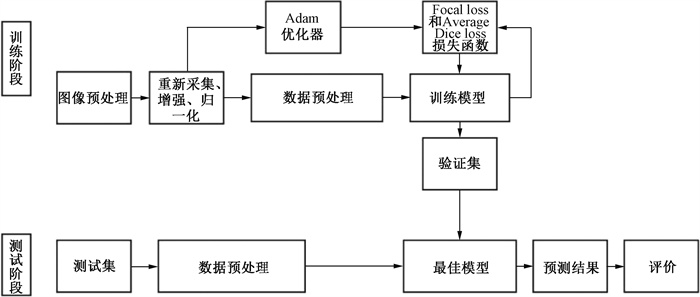

4. 基于3D ResSE-Unet的智能勾画模型训练: 如图 1所示。第一步:将手动勾画完成的974例靶区传输至3D ResSE-Unet模型训练平台,简单随机法分为训练集(874例)、验证集(40例)和测试集(60例), 然后将图像数据进行预处理,包括重新采集、增强及归一化等处理; 第二步:①在PyTorch深度学习框架下搭建3D ResSE-Unet网络模型,并使用Focal loss和Average Dice loss损失函数。②随机裁剪分辨率32 × 256 × 256为图像块,将图像块输入到网络中进行训练,batch为3。③加入随机放大和随机旋转来进行数据扩增。④使用Adam优化器来训练,初始学习率为0.000 5,使用指数衰减策略,衰减系数为0.97,经70个迭代停止训练,并输出最佳模型。

|

图 1 基于3D ResSE-Unet的智能勾画流程图 Figure 1 Flowchart of 3D ResSE-Unet-based intelligent CTV delineation |

5. 模型评估:采用戴斯相似系数(DSC)、95%豪斯多夫距离(HD95)、平均表面距离(ASD)对自动勾画的精度进行评估[11]。

DSC:是一种集合相似度度量指标,主要用于模型预测勾画与人工勾画重合度的评价[12],公式为:DSC=2(Va∩Vm)/(Va+Vm)。式中,Va为自动勾画轮廓的体积; Vm为手动勾画轮廓的体积。DSC的大小在0至1之间,其数值越接近1表示相似度越高,则表明智能勾画的勾画精度越高,大体积器官相似度较高,体积较小的器官相似度较差。

HD:主要用于度量空间中任意两个集合之间的距离,对分割出的边界比较敏感,体现预测智能勾画结果和人工勾画物理偏差[13]。dXY表示点集X到点集Y的单向HD,dYX表示点集Y到点集X的单向HD,dH(X, Y)表示两个点集间的双向HD,距离的度量采用欧氏距离,单位为mm。X、Y均表示点集,而x, y为具体变量。HD95为95% HD距离,可以去除特异值,使结果更能体现勾画效果[14]。公式为:

| $ \begin{gathered} d_H(X, Y)=\max \left\{d_{X Y, } d_{Y X}\right\}= \\ \max \left\{\begin{array}{l} \max \operatorname{mind} \\ x \in X y \in Y \end{array}(x, y), \begin{array}{c} \max \operatorname{mind} \\ y \in Y x \in X \end{array}(x, y)\right\} \end{gathered} $ | (1) |

ASD:表面距离度量也称平均豪斯多夫距离,是用于评估参考标准与分割结果的外表面S和S′之间的误差。表面S中p点到表面S′的距离由欧几里得范数的最小值给出:d(p, S′)=p′∈S′minp-p′2。而平均表面距离是指表面S所有像素到表面S′的距离和表面S′的所有像素到表面S距离的平均值,它用于表示参考标准与分割结果之间表面的平均误差,体现预测智能勾画和人工勾画结果的物理偏差。

6. 统计学处理:所有数据经GraphPad Prism 9.0软件进行分析,所有数据皆进行正态性检验及方差齐性检验,数据结果以x±s表示。如果服从正态分布且方差齐性,采用t检验; 否则使用Wilcoxon秩和检验比较智能靶区勾画模型CTVcw、CTVb及CTV2的DSC值、HD95值及ASD值。P<0.05为差异有统计学意义。

结果1.病例特征:总共纳入974例,选取874例已勾画好的乳腺癌病例作为训练集。其中保乳术后310例:左侧患者为159例(51%),右侧患者为151例(49%),验证集左右各10例,测试集左右各15例; 全乳切除术后564例:左侧患者为282例,右侧患者为282例,各占50%,验证集左右各10例,测试集左右各15例; CTV2为锁骨上下区(部分保乳术后患者也需照射锁骨上下区,而该区域并非手术区域,因此两种术后患者该区域均无解剖学上改变,不再细分亚组),左侧患者为330例,右侧患者为377例,验证集左右各10例,测试集左右各15例。

2.智能勾画验证集结果:利用该3D ResSE-Unet模型对本中心60例患者进行智能勾画,以人工勾画为标准,验证该模型勾画CTV (CTVb、CTVcw、CTV2)的准确性。结果显示,CTVb/cw和CTV2的中位DSC值均较高,均高于0.8,分别为0.83±0.09和0.80±0.10,且CTVb/cw较CTV2更高。CTVb/cw和CTV2的中位HD95值均较小,分别为(14.93±19.80)和(7.83±6.76) mm。CTVb/cw和CTV2的中位ASD值均较小,分别(3.21±3.90)和(2.13±1.75) mm,提示该模型可产生符合临床要求且与人工勾画质量相当的靶区。

3.智能勾画验证集结果

(1) DSC结果:由表 1可知,保乳术后CTVb与全乳切除术后CTVcw相比,保乳术后CTVb具有更高的DSC(0.91 ± 0.03 vs. 0.83 ± 0.05,t=7.11,P < 0.05)。乳腺癌保乳术后的CTVb,左侧DSC值为0.91 ± 0.02,右侧DSC为0.90 ± 0.03(P>0.05);全乳切除术后的CTVcw,左侧DSC值为0.84 ± 0.05,右侧DSC为0.83 ± 0.05 (P>0.05)。左侧CTVb对比左侧CTVcw的DSC值(0.91 ± 0.02 vs. 0.84 ± 0.05),差异有统计学意义(t=5.15,P < 0.05);右侧CTVb对比右侧CTVcw的DSC值(0.90 ± 0.03 vs. 0.83 ± 0.05)差异有统计学意义(t=4.90,P < 0.05)。保乳术后CTVb具有更高的DSC,提示在一致性方面,勾画保乳术后靶区一致性更优。

|

|

表 1 不同数据集上CTVb/cw和CTV2的测试结果(x±s) Table 1 Test results of CTVb/cw and CTV2 of different datasets (mm, x±s) |

(2) HD95结果:CTVb与CTVcw相比,HD95值分别为(7.56±3.42)和(8.77±5.89) mm,差异无统计学意义(P>0.05)。亚组分析提示:左/右侧CTVb,左侧HD95为(6.96±2.69) mm,右侧HD95为(8.17±4.02) mm (P>0.05)。左/右侧CTVcw,左侧HD95为(7.10±2.57) mm,右侧HD95为(10.43±7.69) mm (P>0.05)。左侧CTVb对比左侧CTVcw的HD95[(6.96±2.69) mm vs. (7.10±2.58) mm,P>0.05];右侧CTVb对比右侧CTVcw的HD95值[(8.17±4.02) mm vs. (10.43±7.70) mm,P>0.05];各组之间差异均无统计学意义,各组CTV的HD95均值均较低,提示不管手术方式如何,智能勾画和人工勾画结果的物理偏差均较小。

(3) ASD结果:保乳术后CTVb与全乳切除术后CTVcw相比,ASD值分别为(1.85±0.71) vs. (1.86±0.83) mm (P>0.05)。亚组分析提示,左/右侧CTVb,左侧ASD为(1.78±0.73) mm,右侧HD95为(1.93±0.70) mm (P>0.05);左/右侧CTVcw,左侧ASD为(1.70±0.68) mm,右侧ASD为(2.02±0.96) mm (P>0.05);左侧CTVb对比左侧CTVcw的ASD[(1.93±0.70) mm vs. (1.70±0.68) mm,P>0.05];右侧CTVb对比右侧CTVcw的ASD值[(1.86±0.83) mm vs. (2.03± 0.96) mm,P>0.05];各组差异无统计学意义,各组CTV的ASD均值均较低,HD值与ASD值趋势一致,说明智能勾画结果与手动勾画结果的几何距离差距较小,勾画精度较高。

(4) CTV2的DSC、HD95、ASD结果:由表 1可知,左右侧锁骨上下区CTV2的DSC分别为0.81±0.05和0.82±0.07(P>0.05);两侧HD95分别为(6.91±2.90)和(6.89±3.38) mm (P>0.05),ASD分别为(1.86±0.70)和(1.75±0.93) mm (P>0.05),差异均无统计学意义; 双侧的HD95值及ASD均较低,且趋势一致,提示该模型在CTV2的智能勾画上依旧有较高的一致性跟准确性。

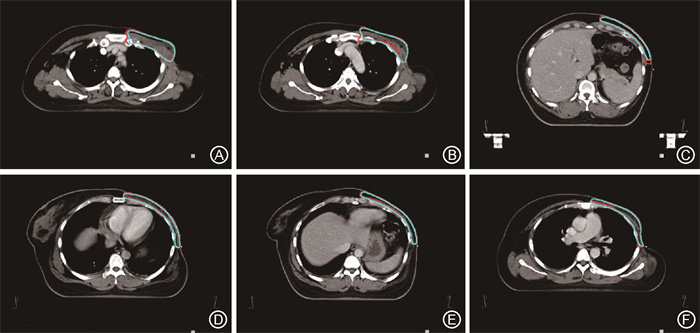

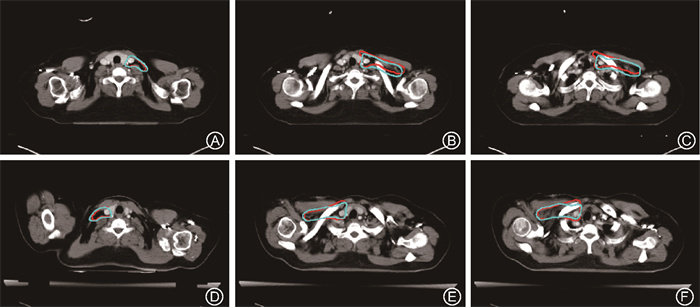

4.层相对位置与不同DCS范围占比关系:将该智能勾画模型应用于临床乳腺癌患者勾画时,发现DSC≥0.9的层面,多位于ROI中间的层面,而头脚方向两侧边界区域,且越靠近边缘DSC降低程度越明显,如图 2~4所示。

|

注:A~D分别为ROI中间的层面,E~F分别为边缘层面; 红色线条为人工勾画,蓝色线条为智能勾画预测 图 2 智能勾画模型在CT图像上所示保乳术后CTVb层面勾画展示 Figure 2 CT images showing CTV of cases treated with breast-conserving surgery (CTVb) obtained using the intelligent delineation model |

|

注:A~C分别为边缘层面,D~F分别为ROI中间的层面; 红色线条为人工勾画,蓝色线条为智能勾画预测 图 3 智能勾画模型在CT图像上所示全乳切除术后后CTVcw层面勾画展示 Figure 3 CT images showing CTV of cases treated with total mastectomy (CTVcw) obtained using the intelligent delineation model |

|

注:A~C分别为示例患者的左侧,D~F分别为示例患者的右侧; 红色线条为人工勾画,蓝色线条为智能勾画预测 图 4 智能勾画模型在CT图像上所示锁骨上下区CTV2层面勾画展示 Figure 4 CT images showing supraclavicular and infraclavicular CTV (CTV2) obtained using the intelligent delineation model |

讨论

乳腺癌的靶区勾画本质上是一种图像分割,可以通过人工智能或者图谱库的方式来实现。随着深度学习的靶区自动勾画在头颈癌、肺癌和前列腺癌中得到广泛研究,并在节省时间和减少不同勾画者的靶区差异上显现出优势[15-17]。

尽管有几项研究报告了基于深度学习的乳腺癌靶区自动勾画的可行性,但仅对同侧乳房CTV进行了训练和测试[18-19]。Eldesoky等[20]用60名患者的数据,基于欧洲放射肿瘤学会(ESTRO)共识指南对乳腺癌放疗进行靶区自动勾画(atlas-based auto-segmentation, ABAS)。ABAS只在部分器官组织(例如肺脏、心脏和乳房)中显示出良好的一致性。由于ABAS的局限性,后续研究逐渐向深度学习的自动勾画方向转变。因此,本研究聚焦于深度学习的自动勾画在乳腺癌放射治疗中的应用[21]。在这项研究中,对于大多数靶区,基于深度学习的算法显示出比ABAS更好的一致性和稳健的性能,对于软组织和较小体积的靶区,这种优势更为明显。

FCN由加州大学伯克利分校的Shelhamer等[22]提出,该方法比常规的基于Patch分类法的图像分割方法效率更高。U-Net采用了一种编码器、解码器结构。编码器通过池化层逐渐减少图像特征的空间维度,解码器通过升采样逐步修复物体的细节和空间维度。编码器和解码器之间通常存在连接,帮助解码器更好地修复目标的细节。通过卷积层和池化层,不断提取图像特征,再通过升采样和卷积层,逐渐恢复目标图像,从而实现端到端的网络模型。U-Net在图像修复和图像分割中均有广泛应用。U-Net将低层特征和高层特征结合在一起学习,并逐步地从采样细致到原图的分辨率。这使得U-Net网络相对于其他架构的网络而言分割效果更加精细,非常适合医学图像的分割。本研究利用U-Net训练基于深度学习的靶区自动勾画模型。

本研究提出了一种名为3D ResSE-Unet的3D Unet,结合了残差连接和通道注意机制。利用三维卷积操作和编码-解码结构,从计算机断层扫描数据中挖掘肿瘤的三维空间信息,利用残差连接和信道注意机制来提高分割性能。而Yu等[23]的研究分析了3D Unet不同深度的分割结果,并将3D ResSE-Unet的性能与3D Unet、3D Res-Unet和3D SE-Unet进行了比较,提出用于Ⅱ期非小细胞肺癌的GTV分割,认为与3D Unet相比,3D ResSE-Unet分割可以实现更准确的分割,并能解决过分割问题。

本研究纳入的乳腺癌患者,全乳切除术后的CTVcw的DSC均>0.80,保乳术后的CTVb的DSC均>0.88,效果良好,这与其他类似研究所获得的结果相似。一项入组800名患者的使用深度学习算法(DD-ResNet)的研究显示,双侧乳房CTV的平均DSC为0.91[18],本研究与之结果类似; 而在与Eldesoky等[20]使用ABAS进行测试的研究结果对比中,ABAS的CTVcw的DSC值为0.76±0.09,而本研究的为0.83±0.05,考虑与靶区勾画统一标准化程度较高有关。本研究结果提示,保乳术后的全乳靶区CTVb在勾画一致性方面更优,DSC值更高,原因可能是靶区体积越大,图像分割精确度越高,而全乳靶区CTVcw的中位体积为575.6 cm3,全乳切除术后胸壁CTVcw的中位体积为280.6 cm3,且胸壁轮廓呈扁弧状狭长内收,智能勾画稳定性欠佳。

同时,本研究不仅对CTVb及CTVcw进行了智能勾画训练,还对其他CTV进行了训练,包括乳腺癌患者的锁骨上下区CTV2。由于该区域淋巴结引流区体积较小且边界不太明确,以往的自动勾画模型表现一般。而本研究中锁骨上CTV2的DSC都接近0.8,提示3D ResSE-Unet所提供的算法表现良好,与临床专家手动勾画的CTV2在质量上表现出良好的一致性。Almberg等[24]报道,在训练出来的模型中, 多数的靶区层面勾画,优于人工勾画, 85%的CTV层面不再需要人工修改或仅需要轻微的修改, 而相差最大层面,多位于头脚方向。乳腺CTV的外侧界,在最广泛使用的RTOG乳腺癌靶区勾画标准[9]和ESTRO乳腺癌靶区勾画指南[25]中将乳腺外侧边界定义为临床可触及的乳腺或乳腺外侧褶皱,而各专家对乳腺边界的理解不同有关, 在CT层面上很难将其明确定义,而这与本研究结果一致。

本研究还存在一定的局限性:①数据来源过于单一,缺少不同层级医疗机构数据,课题后续已启动多中心研究。②数据统计中发现,全乳切除术后的患者,左右胸壁CTVcw的HD95提示左侧自动勾画几何距离差距似乎更小,勾画精度更高,但差异并无统计学意义,这可能与入组患者例数不足有关,接下来的研究将通过3D ResSE-Unet扩大多中心数据样本的积累和特征的提取学习训练,使自动勾画技术的精度能进一步得到提高。③随着3D ResNeXt、3D ResNetSt等3D ResNet的改进模型出现,使得3D RestNet系列模型性得到更进一步地加强以及Transformer逐渐在计算机视觉领域中流行,其可用于建模所有像素之间关系,与只会建模邻域像素之间关系的卷积层形成互补。可以借鉴,将其技术特点融合到本研究的模型中,以获得更好的分割结果。

基于3D ResSE-Unet的自动勾画模型, 在乳腺癌术后患者放疗的临床应用基本可行。智能勾画的应用不仅能减少不同层级放疗单位、不同技术层次放疗医生间乳腺癌CTV勾画的差异,提高靶区勾画准确性,还能缩短放疗医生CTV勾画时间,提高工作效率,进而实现乳腺癌临床靶区勾画的规范化、标准化、同质化。但将来仍需进一步对乳腺癌临床靶区勾画细节规范后再持续优化该模型。

利益冲突 所有作者声明无利益冲突

作者贡献声明 许卓华负责命题的设计、数据的收集整理与分析、论文的撰写; 杨慧负责数据的核对、研究的实施; 江舟负责病例的筛选、数据的整理; 谭军文负责放疗计划的设计; 王占宇负责论文的指导和审阅; 陆颖负责研究方案的设计

| [1] |

Bray F, Ferlay J, Soerjomataram I, et al. Global cancer statistics 2018: GLOBOCAN estimates of incidence and mortality worldwide for 36 cancers in 185 countries[J]. CA Cancer J Clin, 2018, 68(6): 394-424. DOI:10.3322/caac.21492 |

| [2] |

Sung H, Ferlay J, Siegel RL, et al. Global cancer statistics 2020: GLOBOCAN estimates of incidence and mortality worldwide for 36 cancers in 185 countries[J]. CA Cancer J Clin, 2021, 71(3): 209-249. DOI:10.3322/caac.21660 |

| [3] |

Fan L, Strasser-Weippl K, Li JJ, et al. Breast cancer in China[J]. Lancet Oncol, 2014, 15(7): e279-289. DOI:10.1016/S1470-2045(13)70567-9 |

| [4] |

Ciardo D, Gerardi MA, Vigorito S, et al. Atlas-based segmentation in breast cancer radiotherapy: Evaluation of specific and generic-purpose atlases[J]. Breast, 2017, 32: 44-52. DOI:10.1016/j.breast.2016.12.010 |

| [5] |

Velker VM, Rodrigues GB, Dinniwell R, et al. Creation of RTOG compliant patient CT-atlases for automated atlas based contouring of local regional breast and high-risk prostate cancers[J]. Radiat Oncol, 2013, 8: 188. DOI:10.1186/1748-717X-8-188 |

| [6] |

Anders LC, Stieler F, Siebenlist K, et al. Performance of an atlas-based autosegmentation software for delineation of target volumes for radiotherapy of breast and anorectal cancer[J]. Radiother Oncol, 2012, 102(1): 68-73. DOI:10.1016/j.radonc.2011.08.043 |

| [7] |

Falk T, Mai D, Bensch R, et al. U-Net: deep learning for cell counting, detection, and morphometry[J]. Nat Methods, 2019, 16(1): 67-70. DOI:10.1038/s41592-018-0261-2 |

| [8] |

Sun GY, Wang SL, Song YW, et al. Radiation-induced lymphopenia predicts poorer prognosis in patients with breast cancer: a post hoc analysis of a randomized controlled trial of postmastectomy hypofractionated radiation therapy[J]. Int J Radiat Oncol Biol Phys, 2020, 108(1): 277-285. DOI:10.1016/j.ijrobp.2020.02.633 |

| [9] |

Vargo JA, Beriwal S. RTOG Chest wall contouring guidelines for post-mastectomy radiation therapy: is it evidence-based?[J]. Int J Radiat Oncol Biol Phys, 2015, 93(2): 266-267. DOI:10.1016/j.ijrobp.2015.03.001 |

| [10] |

李晔雄. 肿瘤放射治疗学(乳腺癌术后放疗技术)[M]. 北京: 中国协和医科大学出版社, 2018. Li YX. Tumor radiotherapy (postoperative radiotherapy technique for breast cancer)[M]. Beijing: China Union Medical Science University Press, 2018. |

| [11] |

Huttenlocher DP, Klanderman GA, Rucklidge WJ. Comparing images using the Hausdorff distance[J]. IEEE Trans Pattern Anal Mach Intell, 1993, 15(9): 850-863. DOI:10.1109/34.232073 |

| [12] |

Taha AA, Hanbury A. Metrics for evaluating 3D medical image segmentation: analysis, selection, and tool[J]. BMC Med Imaging, 2015, 15: 29. DOI:10.1186/s12880-015-0068-x |

| [13] |

Yang J, Veeraraghavan H, Armato SG 3rd, et al. Autosegmentation for thoracic radiation treatment planning: A grand challenge at AAPM 2017[J]. Med Phys, 2018, 45(10): 4568-4581. DOI:10.1002/mp.13141 |

| [14] |

陈子印, 白艳春, 徐巍, 等. 人工智能云技术在乳腺癌患者心脏亚结构自动勾画中的应用[J]. 中国医学物理学杂志, 2020, 37(12): 1599-1603. Chen ZY, Bai YC, Xu W, et al. The application of artificial intelligence cloud technology in the automatic delineation of cardiac substructure in breast cancer patients[J]. Chin J Med Phys, 2020, 37(12): 1599-1603. DOI:10.3969/j.issn.1005-202X.2020.12.024 |

| [15] |

Kiljunen T, Akram S, Niemelä J, et al. A deep learning-based automated CT segmentation of prostate cancer anatomy for radiation therapy planning-a retrospective multicenter study[J]. Diagnostics (Basel), 2020, 10(11): 959. DOI:10.3390/diagnostics10110959 |

| [16] |

Brunenberg E, Steinseifer IK, van den Bosch S, et al. External validation of deep learning-based contouring of head and neck organs at risk[J]. Phys Imaging Radiat Oncol, 2020, 15: 8-15. DOI:10.1016/j.phro.2020.06.006 |

| [17] |

Poortmans P, Takanen S, Marta GN, et al. Winter is over: The use of artificial intelligence to individualise radiation therapy for breast cancer[J]. Breast, 2020, 49: 194-200. DOI:10.1016/j.breast.2019.11.011 |

| [18] |

Men K, Zhang T, Chen X, et al. Fully automatic and robust segmentation of the clinical target volume for radiotherapy of breast cancer using big data and deep learning[J]. Phys Med, 2018, 50: 13-19. DOI:10.1016/j.ejmp.2018.05.006 |

| [19] |

Chen X, Men K, Chen B, et al. CNN-based quality assurance for automatic segmentation of breast cancer in radiotherapy[J]. Front Oncol, 2020, 10: 524. DOI:10.3389/fonc.2020.00524 |

| [20] |

Eldesoky AR, Yates ES, Nyeng TB, et al. Internal and external validation of an ESTRO delineation guideline-dependent automated segmentation tool for loco-regional radiation therapy of early breast cancer[J]. Radiother Oncol, 2016, 121(3): 424-430. DOI:10.1016/j.radonc.2016.09.005 |

| [21] |

Choi MS, Choi BS, Chung SY, et al. Clinical evaluation of atlas-and deep learning-based automatic segmentation of multiple organs and clinical target volumes for breast cancer[J]. Radiother Oncol, 2020, 153: 139-145. DOI:10.1016/j.radonc.2020.09.045 |

| [22] |

Shelhamer E, Long J, Darrell T. Fully convolutional networks for semantic segmentation[J]. IEEE Trans Pattern Anal Mach Intell, 2017, 39(4): 640-651. DOI:10.1109/TPAMI.2016.2572683 |

| [23] |

Yu XH, Jin F, Luo H, et al. Gross tumor volume segmentation for stage Ⅲ NSCLC radiotherapy using 3D ResSE-Unet[J]. Technol Cancer Res Treat, 2022, 21: 15330338221090847. DOI:10.1177/15330338221090847 |

| [24] |

Almberg SS, Lervåg C, Frengen J, et al. Training, validation, and clinical implementation of a deep-learning segmentation model for radiotherapy of loco-regional breast cancer[J]. Radiother Oncol, 2022, 173: 62-68. DOI:10.1016/j.radonc.2022.05.018 |

| [25] |

Offersen BV, Boersma LJ, Kirkove C, et al. ESTRO consensus guideline on target volume delineation for elective radiation therapy of early stage breast cancer, version 1.1[J]. Radiother Oncol, 2016, 118(1): 205-208. DOI:10.1016/j.radonc.2015.12.027 |

2023, Vol. 43

2023, Vol. 43