2. 中国科学技术大学附属第一医院肿瘤放疗科, 合肥 230001

2. Department of Radiation Oncology, First Affiliated Hospital of USTC, Hefei 230001, China

近年来恶性肿瘤的发病率逐年上升,己成为严重威胁人类健康的疾病[1-2]。约有70%的肿瘤患者需要不同程度地接受放射治疗[3],放射治疗已成为治疗肿瘤的主要手段之一。计算机体层成像(computed tomography,CT)是放射治疗中至关重要的成像模态,提供剂量计算所需的电子密度图,同时也用于病人的摆位矫正。但软组织对比度差是CT图像的主要缺点,这会妨碍靶区和危及器官的勾画。磁共振成像(magnetic resonance imaging,MRI)具有良好的软组织分辨能力,可以改善靶区和危及器官的勾画[4]。同时,MRI成像不会增加患者的辐射剂量,非常适合开展实时的图像引导。MRI丰富的功能成像也为放射治疗未来的发展提供了无限可能[5-6]。然而,MRI图像中的强度信息与电子密度信息间没有相关性,不能直接用于放疗计划的剂量计算[7]。基于MRI的伪CT生成技术有望解决上述问题。其主要分为3大类:基于分割的方法[8-9]、基于图谱的方法[10-11]和基于深度学习的方法[12-13]。其中基于深度学习的方法由于具有自动学习的特点而受到广泛应用。本研究利用对比学习非配对图像转换网络(contrastive learning for unpaired image-to-image translation,CUT)[14]由MRI生成可用于放疗计划的伪CT,并在原有网络的基础上进行改进,比较了不同网络生成的伪CT。

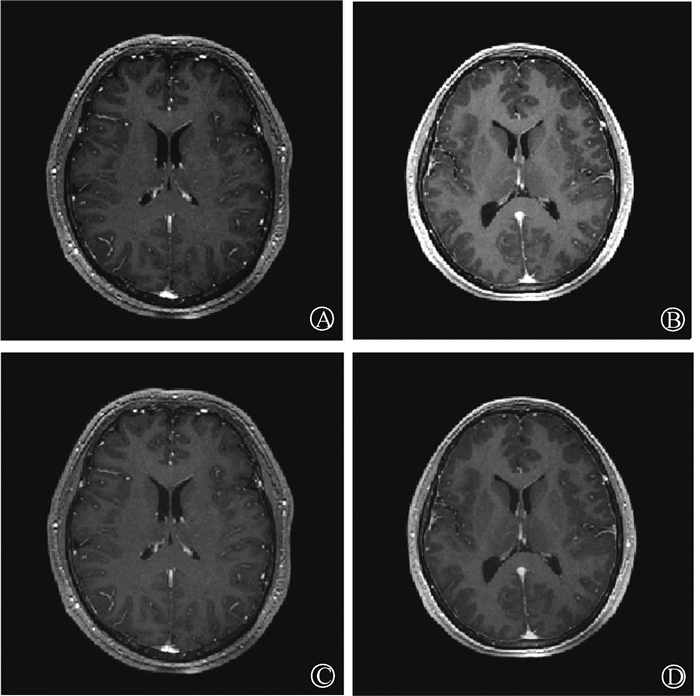

材料与方法1. 图像采集和处理:从中国科学技术大学附属第一医院数据库选取29例接受光子调强放射治疗的脑肿瘤患者,所有患者均进行了CT和MRI扫描。T1序列增强MRI图像(重复时间7.4~8.4 ms, 回波时间2.4~3.1 ms, 翻转角度15°)由1.5T磁共振设备(Signa HDxt, GE Healthcare Technologies, Milwaukee, Wisconsin, USA)扫描获得,其体素大小为0.47 mm×0.47 mm×0.47 mm,图像尺寸为512×512。CT图像是在CT机上(Discovery CT590 RT, GE Healthcare Technologies, Milwaukee, Wisconsin, USA)以120 kV和416 mA扫描获得,其体素大小为0.98 mm×0.98 mm×2.5 mm,图像尺寸为512×512。为了训练这个网络,用MIM软件将MRI刚性配准到CT上,然后将二者重采样并裁剪成体素大小为1 mm × 1 mm × 1 mm、尺寸为241×241的图像。同时为了更好地训练网络,使用MIM获取每个患者的身体轮廓,以去除头罩、治疗床和其他固定装置,对于CT,身体外面的像素值设为-1 024 HU,对于MRI,身体外面的像素值设为0。此外,为了保证不同患者MRI图像强度的一致性,用直方图匹配方法[15]对MRI强度进行标准化。图 1为两例患者标准化前后的MRI图像。

|

图 1 两例患者标准化前后的MRI图像 A、B. 标准化前的MRI图像;C、D. 标准化后的MRI图像 Figure 1 MRI images of two patients before and after normalization A, B. MRI images before normalization; C, D. MRI images after normalization |

训练时,通过简单随机抽样法选取23例患者数据作为训练集,剩余6例患者数据作为测试集。考虑到本研究网络模型生成器的输出层中使用的激活函数为“tanh”,所有MRI和CT都分别根据其最小和最大强度值归一化为[-1, 1][16]。

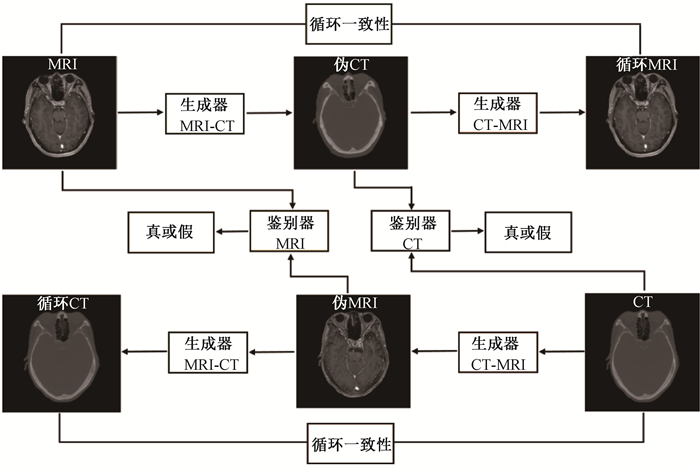

2. CycleGAN:经过上述配准过程,MRI和CT仍然存在局部不匹配问题。循环生成对抗网络(cycle-consistent generative adversarial network,cycleGAN)经常被用来解决此局部不匹配问题[17]。CycleGAN是一种无监督学习的神经网络,可以使用非配对数据将图像从一个域转换到另一个域。这得益于其引入了一个逆映射并加入循环一致性损失函数。该网络的示意图如图 2所示。其具有两个生成器和两个鉴别器并形成前向和后向两个循环。生成器的目标是由输入图像生成可以欺骗过鉴别器使之相信这是一幅真实图像的伪图像,鉴别器的目标是鉴别出这张图像是真实的图像还是伪图像。循环一致性,即一张MRI图像通过正向生成器得到的伪CT图再通过逆向生成器应该得到原始MRI图像;反之亦然,保证了MRI和伪CT在结构上的一致性[18]。

|

图 2 CycleGAN示意图 Figure 2 Schematic flowchart of cycleGAN |

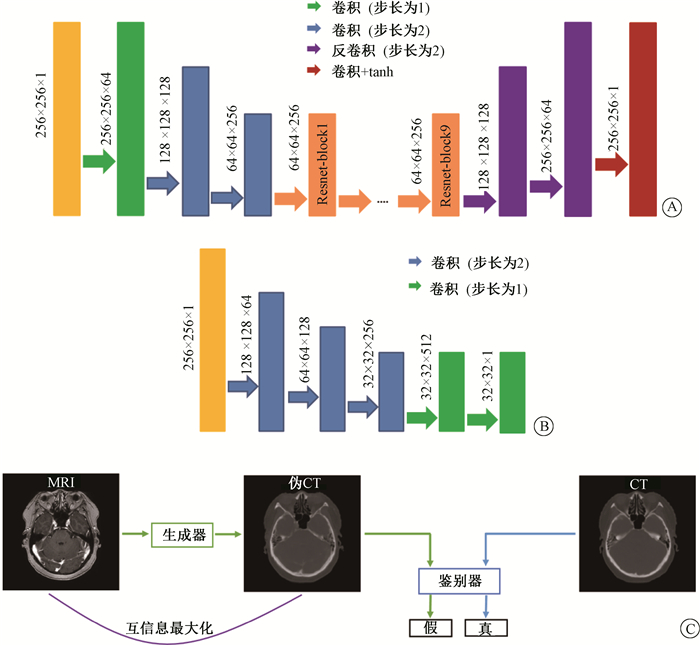

3.CUT:Park等[14]提出一种新的可使用非配对数据进行训练的网络—CUT。与cycleGAN不同,CUT只需要学习一个方向的映射,其由一个生成器和一个鉴别器构成。如图 3所示,CUT的生成器由一个简单的编码器(下采样)、9个残差块和解码器(上采样)组成,编码器主要学习两个领域之间的共性,如物体的结构和形状。鉴别器由三个降采样卷积层跟两个卷积层构成,用来学习分辨图像真伪的能力。除最后一层外,每个卷积层之后都应用实例归一化跟relu激活函数。CycleGAN是通过循环一致性来保证MRI和伪CT在结构的一致,而CUT使用一个对比学习的框架最大化两者之间的互信息来保证他们结构的一致。更多细节详见CUT原文[14]。

|

图 3 CUT示意图及其网络结构 A. 生成器结构;B. 鉴别器结构;C. CUT示意图 Figure 3 Schematic flowchart and network architecture of CUT A. Generator architecture; B. Discriminator architecture; C. Schematic flowchart of cycleGAN |

4.DenseCUT:基于CUT提出了一个新的神经网络denseCUT,主要做了如下改进:

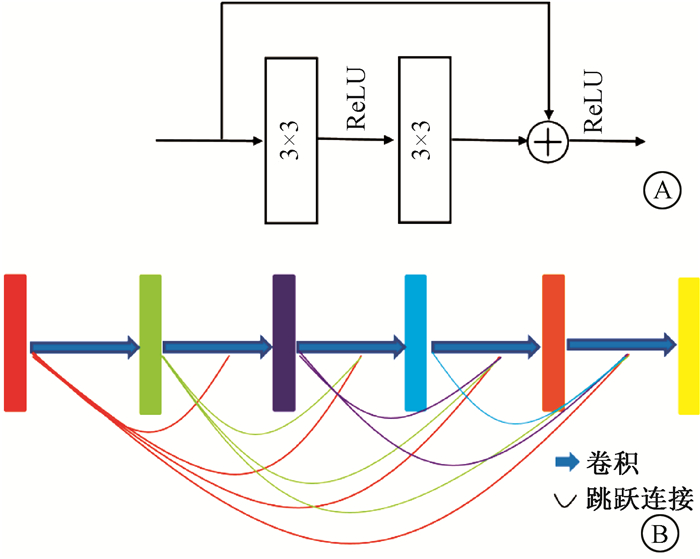

受Dense cycleGAN[17, 19]的启发,将原CUT生成器中的9个残差块改为9个密集块。如图 4所示,残差块通过跳跃连接将之前层的特征图加到之后的层上,迫使网络学习之前卷积层与当前卷积层之间的差异。密集块将前层的输出连接起来,而不是使用求和,以前馈的方式将每一层与其他层连接起来。通过这种方式,可以学习到低频和高频信息并将其结合起来。由于不同患者的MRI图像形状存在显著差异,密集块可以捕获多尺度信息(低频和高频),更好地学习MRI和CT图像之间的关系,从而提高生成器的准确性。

|

图 4 残差块和密集块结构 A. 残差块结构;B. 密集块结构 Figure 4 Architectures of residual block and dense block A. Residual block architecture; B. Dense block architecture |

为了得到更加真实的伪CT图像,在生成器的损失函数中加入多级结构相似性损失函数(LMS_SSIM)。

| $ \begin{array}{l} {L_{{\rm{M}}{{\rm{S}}_ - }}}{\mathop{\rm ssin}\nolimits} = {\left[ {{l_M}({\rm{pCT}},{\rm{CT}})} \right]^{{\alpha _M}}}\prod \\ _{j = 1}^M{\left[ {{c_j}({\rm{pCT}},{\rm{CT}})} \right]^{{\beta _j}}}{\left[ {{s_j}({\rm{pCT}},{\rm{CT}})} \right]^{{\gamma _j}}} \end{array} $ | (1) |

式中,M=5,β1=γ1=0.044 8, β2=γ2=0.285 6, β3=γ3=0.300 1, β4=γ4=0.236 3, α5=β5=γ5=0.133 3。pCT为生成器G由MRI生成的伪CT,l(pCT, CT)、c(pCT, CT)、s(pCT, CT)分别为亮度对比因子、对比度因子和结构对比因子。

| $ \begin{aligned} l(\mathrm{pCT}, \mathrm{CT})=\frac{2 \mu_{\mathrm{pCT}} \mu_{\mathrm{CT}}+C_{1}}{\mu_{\mathrm{pCT}}^{2}+\mu_{\mathrm{CT}}^{2}+C_{1}} \end{aligned} $ | (2) |

| $ c(\mathrm{pCT}, \quad \mathrm{CT})= \frac{2 \sigma_{\mathrm{pCT}} \sigma_{\mathrm{CT}}+C_{2}}{\sigma_{\mathrm{pCT}}^{2}+\sigma_{\mathrm{CT}}^{2}+C_{2}} $ | (3) |

| $ s(\mathrm{pCT}, \quad \mathrm{CT})=\frac{\sigma_{\mathrm{pCTCT}}+C_{3}}{\sigma_{\mathrm{pCT}} \sigma_{\mathrm{CT}}+C_{3}} $ | (4) |

式中,C1=(0.01 L)2;C2=(0.03 L)2;L为CT图像像素的动态范围;μ和δ分别为均值与标准差;σCT ·pCT为CT和pCT的协方差。

5.评判指标:为了量化伪CT的图像质量,采用四个常用的指标: 平均误差(ME)、平均绝对误差(MAE)、峰值信噪比(PSNR)和结构相似性(SSIM)。其计算方式如式(5)~(8)所示:

| $ \begin{aligned} M E =\frac{1}{N} \sum\limits_{i=1}^{N}\left(I_{\mathrm{CT}, i}-I_{\mathrm{pCT}, i}\right) \end{aligned} $ | (5) |

| $ \mathrm{MAE} =\frac{1}{N} \sum\limits_{i=1}^{N}\left|I_{\mathrm{CT}, i}-I_{\mathrm{pCT}, i}\right| $ | (6) |

| $ \begin{gathered} \text { PSNR }=10 \log _{10}\left(\frac{Q^{2}}{\left\|I_{\mathrm{CT}}-I_{\mathrm{pCT}}\right\|_{2}^{2} / N}\right) \end{gathered} $ | (7) |

| $ \text { SSIM }=\frac{\left(2 \mu_{\mathrm{CT}} \mu_{\mathrm{pCT}}+C_{1}\right)\left(2 \sigma_{\mathrm{CTPCT}}+C_{2}\right)}{\left(\mu_{\mathrm{CT}}^{2}+\mu_{\mathrm{pCT}}^{2}+C_{1}\right)\left(\sigma_{\mathrm{CT}}^{2}+\sigma_{\mathrm{pCT}}^{2}+C_{2}\right)} $ | (8) |

式中,ICT、IpCT分别为CT和伪CT的HU值;N为真实CT和伪CT感兴趣区域内的体素个数;Q为真实CT和伪CT的最大HU值;C1=(0.01 L)2、C2=(0.03 L)2;L为CT图像像素的动态范围;μ和σ2分别其均值跟方差;σCT ·pCT为CT和pCT的协方差。

对于患者头部、空腔(HU < -100)、软组织(-100 < HU < 150)和骨头(HU>150),分别计算上述指标。此外,采用常用的伽马通过率(2%/2 mm,10%剂量阈值)作为评判标准,进行剂量分布验证。对于测试集中的所有患者,均在Pinnacle16.2治疗计划系统中,以1 mm×1 mm×1 mm计算网格,基于真实CT进行调强放射治疗计划,再在保持所有计划参数不变的情况下基于伪CT重新计算剂量分布。处方剂量为50 Gy,射野角度分别为30°、90°、140°、180°、220°、275°、330°。将计划CT与伪CT配准,并将计划CT上的ROI轮廓映射到伪CT上,然后比较分别从真实CT与伪CT得到的剂量体积直方图(dose volume histogram,DVH)。

6.方法实施:为了进行对比,cycleGAN、CUT和denseCUT均采用相同的训练参数和策略。所有网络均在pytorch中使用Adam优化器实现,并在NVIDIA GeForce RTX 3070 GPU(8G)上进行训练和测试。所有网络均训练200个周期,前100个周期学习率固定为0.000 2,后100个周期学习率线性衰减至零。

结果1. 训练时间:CycleGAN、CUT和denseCUT所需训练时间分别为:54.4、32.3、32.7 h。相比于cycleGAN,CUT和denseCUT可以节省将近一半的时间,这是因为CUT和denseCUT只需要学习一个方向的映射,而不需像cycleGAN一样额外学习一个逆映射。

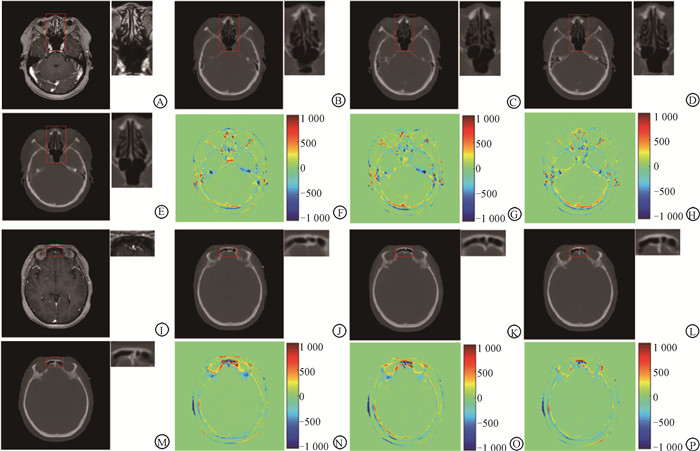

2. 定性评估:图 5展示了不同网络生成的伪CT及其差值图。由差值图可以看出,所有伪CT在软组织中差异很小,而在软组织-空气、骨骼-软组织、空气-软组织界面具有较大的HU值误差,这是因为MRI和CT不是同时获取的,解剖结构无法完全匹配(不存在理想的真值CT,伪CT的预测误差不可避免地包含了配准误差)。此外,骨性边界缺失也可能造成边界处较大的HU值误差。如图 5中放大显示的红框区域所示,与其他两种方法相比,denseCUT更好地保留了组织结构细节。此外,与真实CT相比,由MRI生成的伪CT没有出现金属伪影,如图 6,这是因为训练集中大部分的图像都没有此金属伪影。同时,从图 6也可看出,denseCUT要明显优于其他两种网络,相比于CUT和cycleGAN,denseCUT更好地保留了脑室原有的对比度信息。

|

注:红框中感兴趣的区域被放大显示在每张图的右上方,CT显示窗口为[-1 000, 1 900]HU 图 5 不同网络生成的伪CT及其差值图 A、I. 同一患者不同层的MRI图像;E、M. 对应的CT图像;B~D. cycleGAN、CUT、denseCUT由A生成的伪CT;F~H. B~D减去E得到的差值图;J~L.cycleGAN、CUT、denseCUT由I生成的伪CT;N~P. J~L减去M得到的差值图 Figure 5 Pseudo-CT images generated using different networks and their differences A, I. MRI images of different layers of the same patient; E, M. Corresponding CT images; B-D. Pseudo-CT images generated from A using cycleGAN, CUT, and denseCUT; F-H. Difference images obtained by subtracting E from B-D; J-L. Pseudo-CT images generated from I using cycleGAN, CUT, and denseCUT; N-P. Difference images obtained by subtracting M from J-L |

|

注:显示窗口为[-125, 175]HU 图 6 带有金属伪影的CT与其伪CT A. 带有金属伪影的CT;B~D: CycleGAN、CUT、denseCUT对应得到的伪CT Figure 6 CT images with metal artifact and corresponding pseudo-CT images. A. CT images with metal artifact; B-D. Pseudo-CT images obtained using cycleGAN, CUT, and denseCUT, respectively |

3. 定量评估:不同方法的定量分析结果汇总在表I中,分别计算了6名用于测试的患者在整个头部、骨、空腔和软组织区域的ME、MAE、SSIM和PSNR,每项最好的结果加粗表示。从ME的结果可以看出,三种网络得到的伪CT在骨骼区域有明显的偏低,而在软组织区域有稍微的偏高。DenseCUT的MAE最小,PSNR与SSIM最大,表明denseCUT得到的伪CT准确性更高。

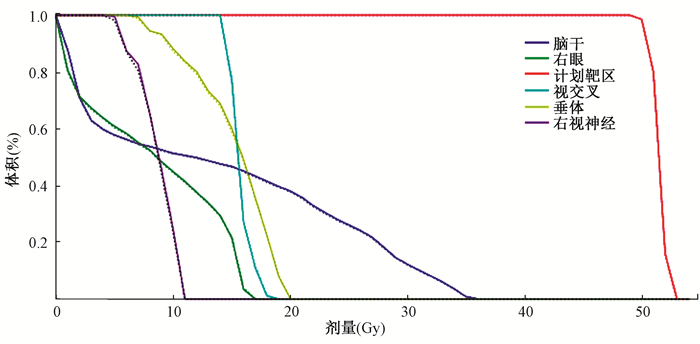

4. 剂量评估:图 7为在一个患者真实CT上进行放疗计划剂量计算得到的DVH与denseCUT生成的伪CT得到的DVH之间的比较。可以看出,两者之间符合地较好,这说明denseCUT生成的伪CT可有效地用于放射治疗计划。另外,不同网络模型之间的剂量计算偏差非常接近,这是由于光子剂量计算对小的CT值变化不敏感。cycleGAN、CUT、denseCUT得到的伪CT对应剂量图的平均伽马通过率分别为98.05%,97.92%,98.31%,本研究的denseCUT在剂量验证方面仍然取得了最好的结果。

|

注:实线表示真实CT对应的DVH,虚线表示denseCUT得到的伪CT对应的DVH 图 7 患者的DVH图 Figure 7 DVHs of a patient |

|

|

表 1 不同网络得到的伪CT与真实CT之间的定量比较 Table 1 Quantitative comparison between pseudo-CT images obtained using different networks and real CT images |

讨论

在脑部,MRI可以分辨CT无法分辨的肿瘤边界和瘤周水肿。此外,MRI是一种多参数成像模式,它不仅可以提供具有高软组织对比度的解剖信息,而且还可以提供有价值的功能信息,用于评估疾病进展和治疗反应[13]。由于剂量计算算法依赖于CT生成的电子密度图来计算剂量,MRI通常被配准到CT上,并与CT一起用于治疗计划。基于MRI的治疗计划将减少与CT相关的辐射剂量和成像成本,从而提高临床效率并实现高精度的治疗计划。此外,治疗计划所需的解剖和功能成像都可以在同一成像过程中实现,从而减少图像配准误差。然而,用MRI替代CT的主要挑战是MRI不能提供剂量计算所需的电子密度信息。

本研究利用深度学习的方法由MRI生成可用于放疗计划的伪CT,伪CT可提供剂量计算所需的电子密度信息。基于深度学习的方法一般包括两个部分,训练跟测试。训练阶段从MRI-CT对中学习MRI和CT图像之间的复杂非线性的映射关系。一旦训练完成,当输入新的MRI时,可以在短时间内预测新的伪CT。

本研究基于CUT提出的denseCUT有两点新颖之处。一是将生成器中的残差块改为密集块。学习两种不同图像域之间的映射不仅依赖于深度学习神经网络捕获结构信息的能力,而且还依赖于其捕获纹理信息的能力。生成器获取的信息越多、多尺度特征越多,网络学习到的一对一映射越好。这大大增强了所提方法在发生局部不匹配和不对齐时生成正确组织边界的能力。二是为了得到更加真实的伪CT图像,在生成器的损失函数中加入多级结构相似性。结果表明,denseCUT方法要优于另外两种方法,所获得的伪CT更接近于真实CT。此外,CUT和denseCUT只需要学习一个方向的映射,避免了使用反向的生成器和鉴别器,简化了训练过程,减少了训练时间。相比于cycleGAN,CUT和denseCUT可节省约一半的训练时间。

在T1序列的增强MRI中,骨组织与空气的边界模糊,生成伪CT图像时可能引入偏移误差。这对剂量计算准确性的影响,特别是对边界附近组织剂量的影响,需要进一步评估。Qi等[16]的研究表明,由于不同MRI序列包含不同的组织信息,同时将多个序列作为输入可以得到比单个序列输入更好的结果。另一方面,超短回波时间(ultrashort echo time, UTE)序列可提供更好的骨组织信号,在输入中加入UTE序列MRI将有助于伪CT中骨-气边界的区分。

不同的MRI扫描仪可能有不同的信号强度和图像质量。目前还不清楚如果训练数据集来自一个扫描仪而测试数据集来自另一个扫描仪将会对该方法产生怎么样的影响。未来的研究将包含在不同扫描仪上获得的患者数据,进一步测试所提方法的临床应用范围。

由于GPU内存的限制,本研究提到的三种网络模型都是在2D图像上进行训练的,这可能导致所生成的伪CT在第三个维度上的连续性不好。接下来本研究将考虑在3D图像上直接进行模型训练,评估该方法输出的图像质量差异。

总之,本研究提出的denseCUT能更准确地生成伪CT,伪CT能满足调强放疗计划剂量计算的需求。而且,相比cycleGAN网络,denseCU网络更节省训练时间。

利益冲突 所有作者声明无利益冲突

作者贡献声明 王江涛、吴新红负责设计和实施实验、论文撰写;闫冰负责收集数据;朱磊、杨益东负责研究指导、论文修改

| [1] |

Singh H, Koomson AS, Decker KM, et al. Continued increasing incidence of malignant appendiceal tumors in Canada and the United States: A population-based study[J]. Cancer, 2020, 126(10): 2206-2216. DOI:10.1002/cncr.32793 |

| [2] |

van der Meer DJ, Karim-Kos HE, van der Mark M, et al. Incidence, survival, and mortality trends of cancers diagnosed in adolescents and young adults (15-39 years): a population-based study in the Netherlands 1990-2016[J]. Cancers (Basel), 2020, 12(11): 64-65. DOI:10.3390/cancers12113421 |

| [3] |

王曼曼, 刘晔, 孙华威. 放射性治疗技术的临床应用[J]. 黑龙江医药科学, 2011, 34(4): 64-65. Wang MM, Liu Y, Sun HW. Clinical application of radiotherapy technology[J]. Heilongjiang Med Pharm, 2011, 34(4): 64-65. DOI:10.3969/j.issn.1008-0104.2011.04.044 |

| [4] |

Bahrami A, Karimian A, Fatemizadeh E, et al. A new deep convolutional neural network design with efficient learning capability: Application to CT image synthesis from MRI[J]. Med Phys, 2020, 47(10): 5158-5171. DOI:10.1002/mp.14418 |

| [5] |

Bhatnagar P, Subesinghe M, Patel C, et al. Functional imaging for radiation treatment planning, response assessment, and adaptive therapy in head and neck cancer[J]. Radiographics, 2013, 33(7): 1909-1929. DOI:10.1148/rg.337125163 |

| [6] |

Thorwarth D. Functional imaging for radiotherapy treatment planning: current status and future directions-a review[J]. Br J Radiol, 2015, 88(1051): 20150056. DOI:10.1259/bjr.20150056 |

| [7] |

Edmund JM, Nyholm T. A review of substitute CT generation for MRI-only radiation therapy[J]. Radiat Oncol, 2017, 12(1): 28. DOI:10.1186/s13014-016-0747-y |

| [8] |

Lee YK, Bollet M, Charles-Edwards G, et al. Radiotherapy treatment planning of prostate cancer using magnetic resonance imaging alone[J]. Radiother Oncol, 2003, 66(2): 203-216. DOI:10.1016/s0167-8140(02)00440-1 |

| [9] |

Chin AL, Lin A, Anamalayil S, et al. Feasibility and limitations of bulk density assignment in MRI for head and neck IMRT treatment planning[J]. J Appl Clin Med Phys, 2014, 15(5): 4851. DOI:10.1120/jacmp.v15i5.4851 |

| [10] |

Uh J, Merchant TE, Li Y, et al. MRI-based treatment planning with pseudo CT generated through atlas registration[J]. Med Phys, 2014, 41(5): 051711. DOI:10.1118/1.4873315 |

| [11] |

Demol B, Boydev C, Korhonen J, et al. Dosimetric characterization of MRI-only treatment planning for brain tumors in atlas-based pseudo-CT images generated from standard T1-weighted MR images[J]. Med Phys, 2016, 43(12): 6557. DOI:10.1118/1.4967480 |

| [12] |

Largent A, Barateau A, Nunes JC, et al. Comparison of deep learning-based and patch-based methods for pseudo-CT generation in MRI-based prostate dose planning[J]. Int J Radiat Oncol Biol Phys, 2019, 105(5): 1137-1150. DOI:10.1016/j.ijrobp.2019.08.049 |

| [13] |

Kazemifar S, McGuire S, Timmerman R, et al. MRI-only brain radiotherapy: Assessing the dosimetric accuracy of synthetic CT images generated using a deep learning approach[J]. Radiother Oncol, 2019, 136: 56-63. DOI:10.1016/j.radonc.2019.03.026 |

| [14] |

Park T, Efros AA, Zhang R, et al. Contrastive learning for unpaired image-to-image translation[C]. Glasgow: European Conference on Computer Vision, 2020: 319-345. DOI: 10.1007/978-3-030-58545-7_19.

|

| [15] |

Nyúl LG, Udupa JK, Zhang X. New variants of a method of MRI scale standardization[J]. IEEE Trans Med Imaging, 2000, 19(2): 143-150. DOI:10.1109/42.836373 |

| [16] |

Qi M, Li Y, Wu A, et al. Multi-sequence MR image-based synthetic CT generation using a generative adversarial network for head and neck MRI-only radiotherapy[J]. Med Phys, 2020, 47(4): 1880-1894. DOI:10.1002/mp.14075 |

| [17] |

Lei Y, Harms J, Wang T, et al. MRI-only based synthetic CT generation using dense cycle consistent generative adversarial networks[J]. Med Phys, 2019, 46(8): 3565-3581. DOI:10.1002/mp.13617 |

| [18] |

Zhu JY, Park T, Isola P, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks[C]. Venice: IEEE International Conference on Computer Vision, 2017: 2223-2232. DOI: 10.1109/iccv.2017.244.

|

| [19] |

Liu Y, Lei Y, Wang Y, et al. Evaluation of a deep learning-based pelvic synthetic CT generation technique for MRI-based prostate proton treatment planning[J]. Phys Med Biol, 2019, 64(20): 205022. DOI:10.1088/1361-6560/ab41af |

2022, Vol. 42

2022, Vol. 42